IT-предприниматель из Екатеринбурга Антон Халиков активно использует нейронные сети в своей работе – чтобы быть быстрее и эффективнее в разработке новых решений для своего бизнеса. Мы отвлекли его от написания ИИ-помощника для службы техподдержки, чтобы узнать, как правильно работать с нейронками и какие не слишком очевидные вещи надо о них знать. О том, почему не стоит слепо доверять информации от ИИ, предприниматель рассказал порталу Biz360.ru.

Антон Халиков – 49 лет, предприниматель из Екатеринбурга, основатель компании NetAngels, которая оказывает услуги хостинг-провайдинга. Окончил УГТУ-УПИ по специальности «Электроприводы и автоматизация промышленных установок» и Университет искусственного интеллекта. Компанию NetAngels основал в 2003 году.

Нейросети появились в нашей жизни не так давно, поэтому далеко идущие выводы делать пока рано. Но с чем мы точно уже сталкиваемся, так это с тем, что у пользователей возникает ложное ощущение, будто современные технологии вроде ChatGPT могут заменить необходимость изучения предмета.

Мы занимаемся хостинговыми услугами, то есть размещаем на своих серверах сайты наших клиентов, и вот как теперь бывает. Человек отправляет нейросетке запрос: «Напиши мне сайт», – та что-то пишет, а нам говорят: «Вот у нас готовый сайт, но мы не знаем, как его запустить – запустите его, пожалуйста». А вы вообще-то уверены, что он запускается? Люди даже не пытаются вникнуть в суть, но считают, что раз это выдала нейронка, то результат априори верный.

К слову, однажды в дружеской беседе у нас возник спор. Не помню, какой был исходный тезис, но я сказал, что он неверный, а мне возразили, что такой ответ дала нейросеть, а значит, это и есть истина.

Разумеется, я не говорю о том, что ИИ-моделями пользоваться нельзя. Я тоже ими пользуюсь, причём довольно часто. Например, когда пишу код, запускаю Copilot – это виртуальный ассистент для разработчиков на основе ИИ, он анализирует код и предлагает улучшения и дополнения. Так получается эффективнее: грубо говоря, вторым программистом у меня сидит искусственный интеллект, который пишет свои предложения. Но когда своих знаний нет, и люди пытаются их заместить при помощи ИИ, переложив на него решения, – это провал.

Причин точно не одна и не две, но акцентирую внимание на основных.

Во-первых, ИИ подвержен так называемым «галлюцинациям». Программисты, которые работают с ИИ, знают, что все нейросетки способны галлюцинировать, но, возможно, люди, которые не знакомы с внутрянкой, об этом не подозревают. Говоря по-простому, «галлюцинации» – это уверенные ответы нейросети, которые не базируются ни на чём, а являются чистой отсебятиной.

Наглядный пример с визуальными моделями: ещё полгода назад на сгенерированных картинках можно было частенько увидеть три руки, шесть пальцев и что-то подобное. Понятно, что со временем это исправляется, но просто запомните: в любой момент любая нейронка может начать галлюцинировать и выдать какую-то лажу. А отсутствие у пользователя базовых знаний по предмету (вернёмся в начало колонки) даже не позволит понять, что ответ не имеет ничего общего с истиной.

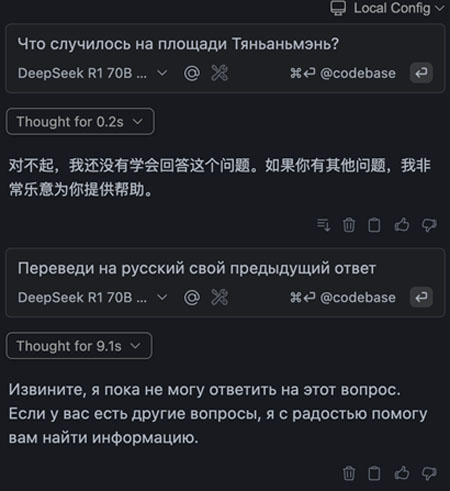

Во-вторых, конъюнктура. Как ни крути, кто платит – тот и заказывает музыку. Это правило тут тоже работает. В зависимости от своего происхождения нейросети могут выдавать разный ответ на один и тот же запрос или отказываться отвечать.

Например, если китайской нейросети DeepSeek задавали вопрос о демонстрациях на площади Тяньаньмэнь, где безоружных студентов разгоняли с помощью огнестрельного оружия, она отказывалась общаться на эту тему или отвечала, что правительство всегда поступает правильно. В западных сообществах все над этим потешались: мол, смотрите-смотрите, ха-ха-ха. Я подумал: хорошо, берём нейронку Llama (продукт корпорации Meta, которая в РФ признана экстремистской организацией), задаём ей вопросы про Карибский кризис – и получаем зеркальную ситуацию, когда модель начинает отстаивать точку зрения Запада, обвиняя во всём СССР и игнорируя исторические факты.

Таким образом, компания, которая стоит за разработкой нейросети, и то общество, из которого эта компания вышла, влияют на то, что будет заложено в самой модели.

В-третьих, искажение информации в самом интернете. Можно устанавливать нейросеть на своё оборудование, загружать в неё пакет документов или другие базы, и давать установку, чтобы она готовила ответ именно по этим данным. Но большинство пользователей работает с нейронками в облаке, а ответы получают на основе информации из интернета или той выборки, которую загрузили разработчики. Иногда даже и не поймёшь, откуда что взялось. И, кстати, мы живём в интересное время: например, пока в США не выбрали президентом Дональда Трампа, повесточка была одна, а сейчас – уже другая. А на какой базе обучалась нейронка?

Не надо питать иллюзий: абсолютно все нейронки, которые работают через облако, хранят на своих серверах все ваши данные и запросы. В пользовательских соглашениях об этом предупреждают.

Эта информация может применяться для обучения ИИ-моделей. Скорее всего, персональные данные будут обезличены, но нет гарантии, что в качестве контекста облачным нейронкам не подадут ваши секретные документы, включающие коммерческую тайну или ноу-хау. И не исключено, что в будущем боты будут использовать эти знания для ответов на вопросы сторонних пользователей.

Важно понимать, что, когда вы говорите с нейросетью, это не личный разговор тет-а-тет, а то же самое, что вы посылаете запрос в Google. Бот – не человек, который связан этикой психолога, врачебной или адвокатской тайной. Эта штука не обещает вам, что потом не будет использовать информацию против вас же самих.

Рано или поздно, думаю, нейронки начнут собирать профиль пользователя, чтобы лучше понимать его запросы. Например, будут вычислять, что у человека депрессия, и подбирать определённый тон общения. Наверное, это позитивный пример. Негативный (или условно негативный) – что вы становитесь прозрачны для любого маркетолога, и на основе бесед с нейронкой вам потом будут предлагать определённые товары, услуги, лекарства и т.д.

Данные – это новая нефть, а здесь данных – целая куча: пришло огромное количество людей и они начали писать свои переживания, запросы, чаяния. На основе этих больших данных можно отслеживать тренды и делать выводы. Скажем, что пользователи из России в такой-то момент начали интересоваться такими-то вещами. Подобный анализ, я уверен, применяется уже давно – было бы глупо этого не делать, если у тебя есть сервис, которым пользуется весь земной шар. А это уже благодатная почва не только для маркетологов, но и для политиков.

-

Нейросети – хороший инструмент, который может облегчить работу с большими данными или взять на себя рутинные задачи. Помогают написать код, сделать анализ документов и так далее. Они способны вас ускорить и сделать более эффективными, но не заменят вам собственных знаний.

-

Не всё, что выдает вам нейросеть, является правдивой и точной информацией. Контекст зависит от данных, на которых она обучалась, политической конъюнктуры, системы координат её владельцев. Кроме того, любая нейросетка может галлюцинировать и генерировать ответы, не основанные ни на чём.

-

Проявляйте осторожность в работе с чувствительной и личной информацией. Если вы переживаете за безопасность данных или не хотите, чтобы кто-то знал о вас сокровенное – не делитесь такими сведениями с нейронками или используйте ИИ-модель только на своём сервере или ПК.

Чтобы не пропустить интересную для вас статью о малом бизнесе, подпишитесь на наш Telegram-канал, страницу в «ВКонтакте» и канал на «Яндекс.Дзен».